Generative KI-Modelle, insbesondere große Sprachmodelle (LLMs), bieten vielfältige Möglichkeiten, Texte, Bilder und Musik zu erzeugen, indem sie Muster aus Trainingsdaten lernen und anwenden.

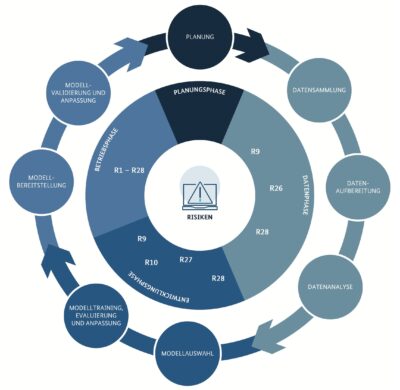

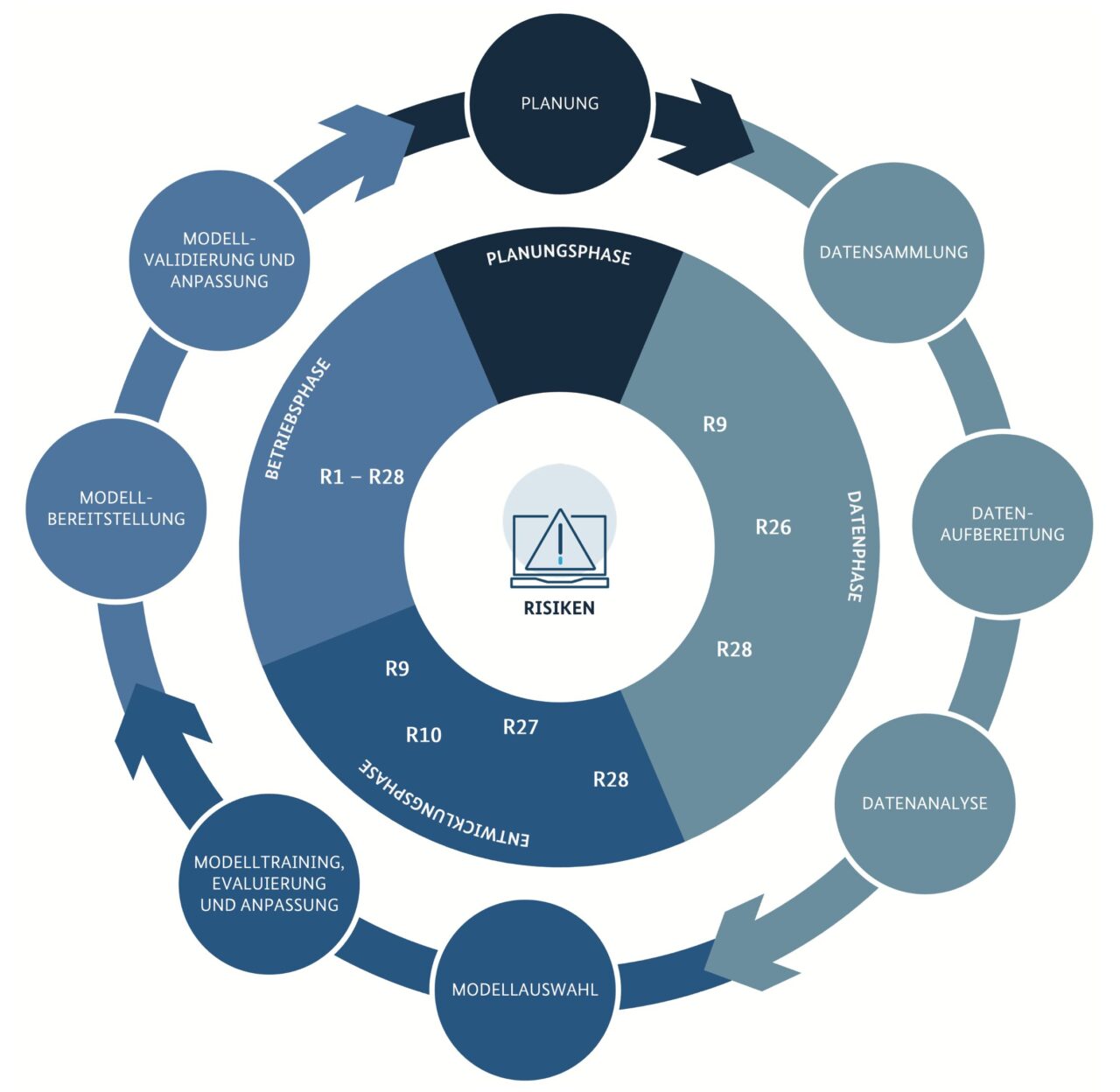

(Grafik: BSI)

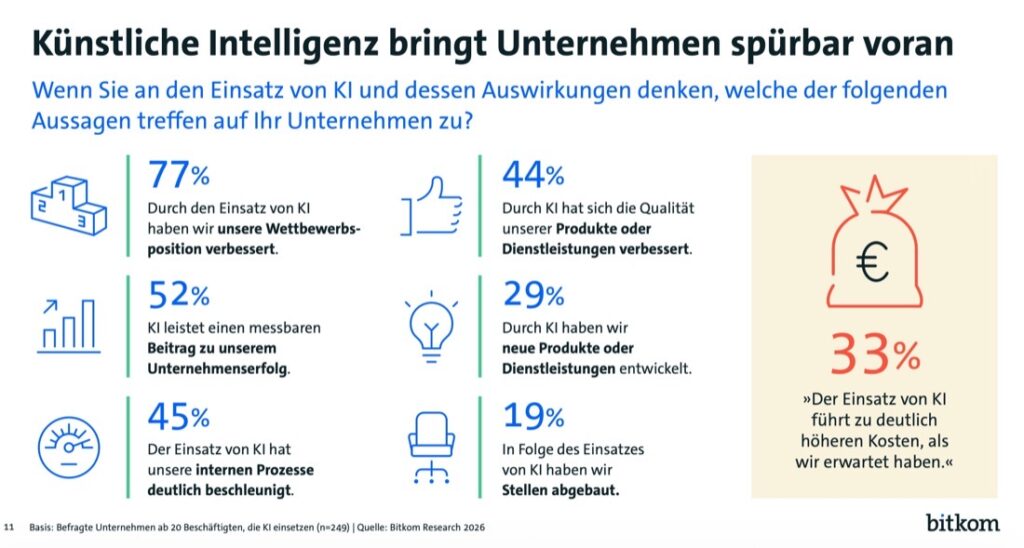

Diese Technologien können in öffentlichen Verwaltungen und in Unternehmen zur Effizienzsteigerung beitragen, etwa durch automatisierte Texterstellung oder Datenanalyse. Allerdings bergen sie auch Risiken, besonders im Bereich der IT-Sicherheit, da sie neue Angriffsflächen bieten.

Das Bundesamt für Sicherheit in der Informationstechnik (BSI) hat eine 36-seitige Broschüre zu Chancen und Risiken zusammengestellt und kürzlich aktualisiert. Beispielsweise könnten Kriminelle LLMs nutzen, um glaubwürdig wirkende, aber falsche Informationen zu verbreiten. Daher ist es entscheidend, dass Entwicklerinnen und Entwickler sowie Betreibende von LLMs eine gründliche Risikoanalyse durchführen und Sicherheitsmaßnahmen implementieren. Für einen verantwortungsvollen Einsatz ist es außerdem wichtig, dass Nutzende von LLMs über potenzielle Risiken aufgeklärt werden und die Technologie kritisch im Hinblick auf Datenschutz und Sicherheit bewerten.

- Generative KI-Modelle: Chancen und Risiken für Industrie und Behörden (PDF, 36 Seiten, 3 MB)